概要

富士通デザイン株式会社さまのFace Galleryにて調光フィルム演出システムの製作を行いました。調光フィルムは電圧を加えると透明になるフィルムで、以前弊社が演出製作を担当しましたEQ Houseで使われている調光フィルムと同じものを使用しており、 今回はさらに人物のモーションと声によるインタラクティブ演出を加えることによって、人と調光フィルムをより密接に連動させた演出内容に仕上がっています。

モード

調光フィルム演出システムは人物の動きに応じて3つのモードに変化します。

1. ジェスチャーモード

右手を挙げるとジェスチャーモードに切り替わります。このモードで右手を左右に振ると向きに応じて調光フィルムがグラデーションの波を演出します。また、手のスピードによって演出の速度も変化します。

2. 透過モード

左手を挙げると透過度モードに切り替わります。このモードで左手を上下に振ると手の高さに応じて調光フィルム全体の透過度が変化します。

3. 音量モード

声の音量に応じて調光フィルム全体の透過度が変化します。デフォルトではこのモードになっています。人物を検出するとジェスチャーモードに変化し、透過度モードとは左右の手を上げ下げすることでモードを切り替えることができます。

人物がカメラから外れると再び音量モードに変化します。

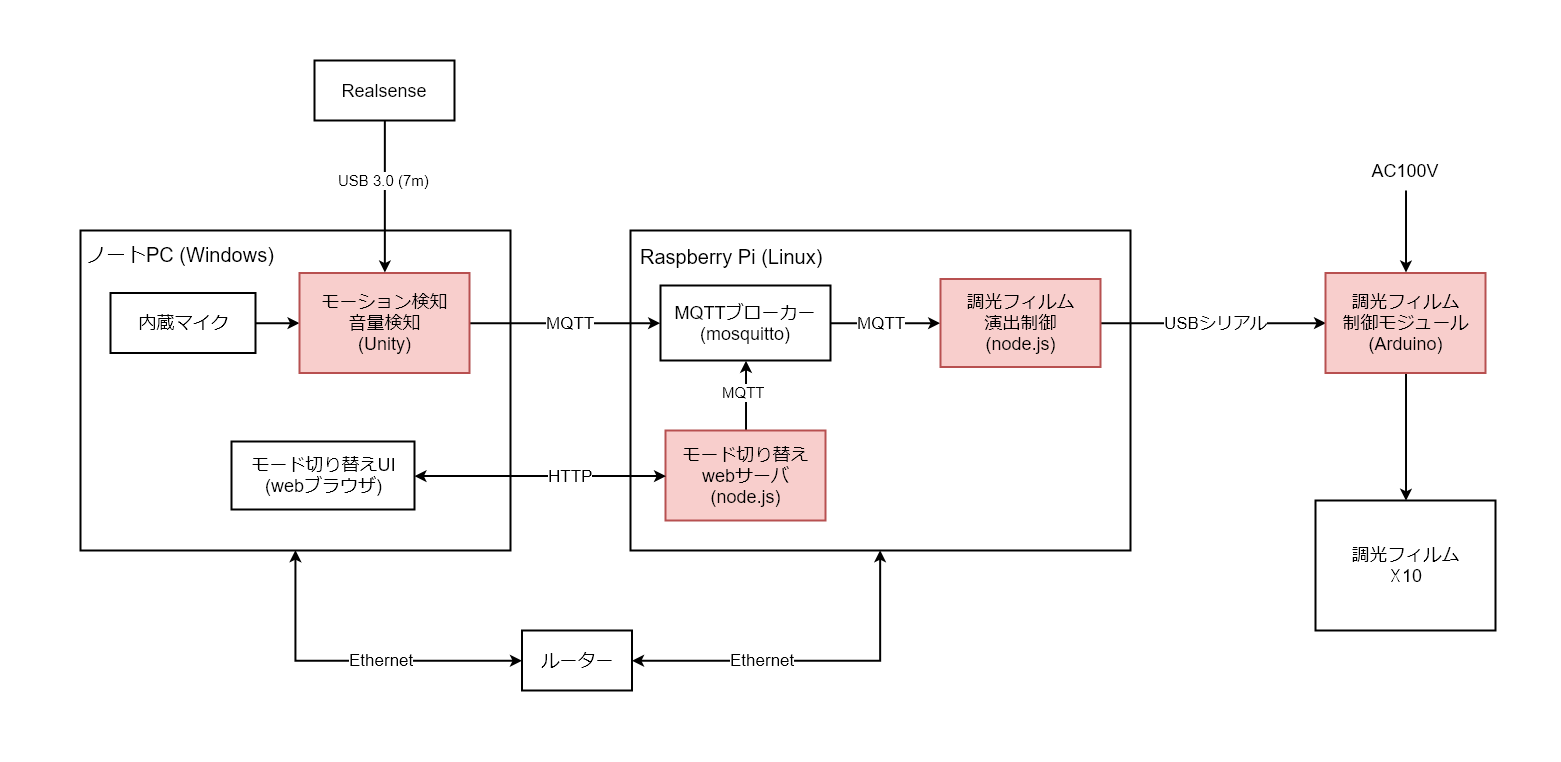

構成図

各機能を処理するコードはMQTT通信で結ばれています。人物検出の部分はMicrosoft社のKinectが販売終了になってしまっているため、代替手段を検討した結果、以前から気になっていたIntel社のRealsense(D435i)を導入しました。

RealsenseはDepthカメラを内蔵しており、物体の深度データを取得できるSDKがIntelから公開されているのですが、人物のボーンを取得できる関数やライブラリが提供されていないため、ボーンの検出にはNuitruckを使ってUnityで制御を行っています。

また調光フィルムは1枚の窓に複数枚のフィルムを並べて張り合わせてあり、計10枚のフィルムは独立した制御が可能になっています。

文&解説:Takahiro Yasui

Photo:Cazunari Muraho

コメント

Unityに初めて触ることでUnityの世界観を体験できたこと、Realsenseも初めて使うなど挑戦的な試みということもあって技術的好奇心を大いに満たすことができました。 モーションは検出したボーンを3D空間に配置して処理しているため、3D空間と親和性の高いUnityを使うことで少ない手間で開発できたように思います。センサを利用して現実世界の情報を仮想世界に入れ込んだり、一旦デジタル処理したあと再び現実世界に戻すことで様々な表現や演出がUnityで簡単にできるようになるので、これを機にもっとUnityの理解を深めていければなと思います。🌱

案件の窓口として、クライアントと社内メンバーの間に立って、要件の整理や制作物についての認識を合わせるところのコミュニケーションを担当しました。以前やった別案件とお客さんを含めたメンバー的なところでも、使う技術の要素的なところでも類似する面の多い案件でしたのでやりやすさもあり、またその余裕から各メンバーに技術的なチャレンジをしてもらう事もでき、いい案件だったと思っていあす。

調光フィルムのアニメーション演出と、各ブラウザから操作できる管理用のUIアプリケーションの開発を担当しました。Raspberry-Pi上に調光デバイスとの通信と各センサーパートと通信して演出を決めるプログラムをNode.jsで組んでいます。各センサーの状態やUIからの操作などで常に変化しつつ、破綻のない演出をするのが苦労したポイントです。